Data Kwaliteit: Het Fundament van Succesvolle AI

Gepubliceerd op

Inhoudsopgave

"Onze AI werkt niet goed." Dit horen we vaak. En bijna altijd is het antwoord: "Het ligt niet aan de AI, maar aan je data."

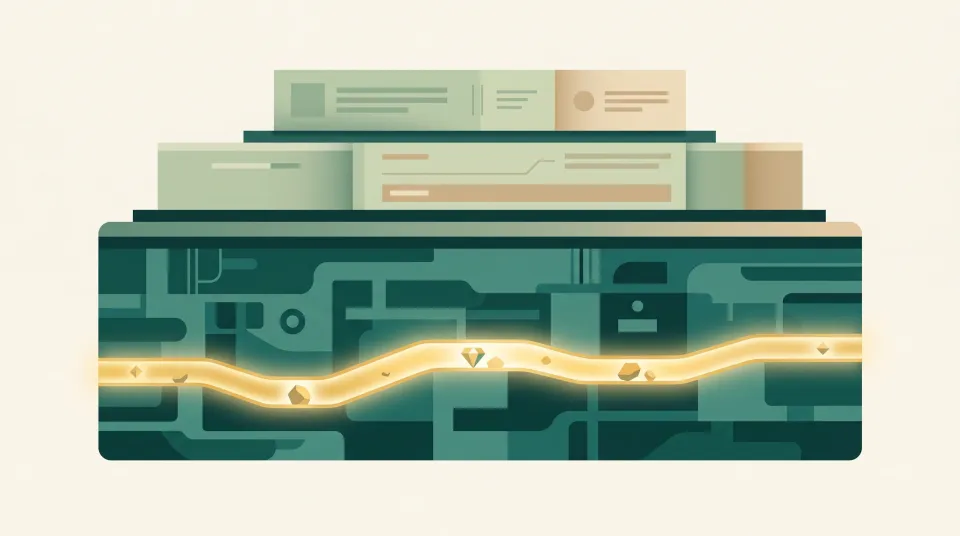

Garbage in, garbage out - dit gezegde is bij AI letterlijk waar. De beste ML-modellen presteren slecht met slechte data. En andersom: middelmatige modellen presteren uitstekend met kwalitatieve data.

In dit artikel leer je wat datakwaliteit betekent, hoe je slechte data herkent, en vooral: hoe je datakwaliteit structureel verbetert en borgt.

💡 Dit artikel is onderdeel van onze complete gids over AI Procesoptimalisatie. Bekijk het volledige traject en implementatie-tips.

Wat is Datakwaliteit? 6 Dimensies

Datakwaliteit is niet één ding. Het bestaat uit zes kritieke dimensies:

1. Volledigheid (Completeness)

Wat: Zijn alle vereiste velden ingevuld?

Voorbeeld slechte data:

Klantrecords zonder e-mailadres

Facturen zonder leverancier-ID

Orders zonder afleveradres

Impact op AI: ML-modellen kunnen geen voorspellingen maken zonder complete input. 30% missing data = 30% lagere accuratesse.

2. Actualiteit (Timeliness)

Wat: Is de data up-to-date?

Voorbeeld slechte data:

Klantdata met verouderde adressen

Voorraadniveaus die 1x per week updaten (ipv realtime)

Prijslijsten van vorig jaar

Impact op AI: Voorspellingen gebaseerd op verouderde patronen zijn waardeloos. Vooral bij dynamische processen (voorraad, prijzen, vraag).

3. Consistentie (Consistency)

Wat: Is dezelfde data hetzelfde weergegeven in alle systemen?

Voorbeeld slechte data:

Klant "Jansen B.V." vs "B.V. Jansen" vs "Jansen" (3× hetzelfde bedrijf)

Datum als "28-10-2025" vs "2025-10-28" vs "28 okt 2025"

Product "XL" in ERP vs "Extra Large" in webshop

Impact op AI: ML ziet dit als drie verschillende entiteiten, waardoor patronen gemist worden en accuratesse daalt.

4. Nauwkeurigheid (Accuracy)

Wat: Klopt de data met de werkelijkheid?

Voorbeeld slechte data:

Typo's in adressen (levering mislukt)

Verkeerde productcodes (fout item verzonden)

E-mail bounce rates > 20% (foute e-mails)

Impact op AI: Modellen leren van fouten en nemen die over. "Garbage in, garbage out".

5. Relevantie (Relevancy)

Wat: Is deze data relevant voor het doel?

Voorbeeld slechte data:

ML-model voorspelt vraag, maar gebruikt data van 10 jaar geleden (niet meer relevant)

Lead scoring met data van prospects die nooit klant werden

Inclusief test-data of intern gebruik in trainingsset

Impact op AI: Model leert de verkeerde patronen en voorspellingen kloppen niet met huidige situatie.

6. Toegankelijkheid (Accessibility)

Wat: Kan de data bereikt en gebruikt worden wanneer nodig?

Voorbeeld slechte data:

Data zit in 8 verschillende systemen zonder integratie

Excel-sheets op lokale harde schijven

Legacy systemen zonder API

Impact op AI: Als data niet toegankelijk is, kan AI er niet mee werken. Punt.

Symptomen van Slechte Data: Herken je dit?

Hoe weet je of jouw data een probleem is? Deze symptomen zijn alarmsignalen:

🚨 AI-modellen presteren slecht

ML-accuratesse < 70% terwijl benchmark 85%+ is

Voorspellingen kloppen niet met werkelijkheid

Model presteert goed in test, maar slecht in productie ("model drift")

🚨 Gebruikers vertrouwen de output niet

"Dat kan niet kloppen" - medewerkers checken alles handmatig

Lage user adoption (AI wordt niet gebruikt)

Veel uitzonderingen en handmatige correcties

🚨 Integraties falen

RPA-bots breken omdat data onverwacht formaat heeft

API-calls falen door missende verplichte velden

Synchronisatie tussen systemen loopt vast

🚨 Dashboards/rapportages kloppen niet

Cijfers verschillen per systeem

MT vraagt: "Welk cijfer is nou waar?"

Rapporten worden handmatig "gecorrigeerd" voordat ze gedeeld worden

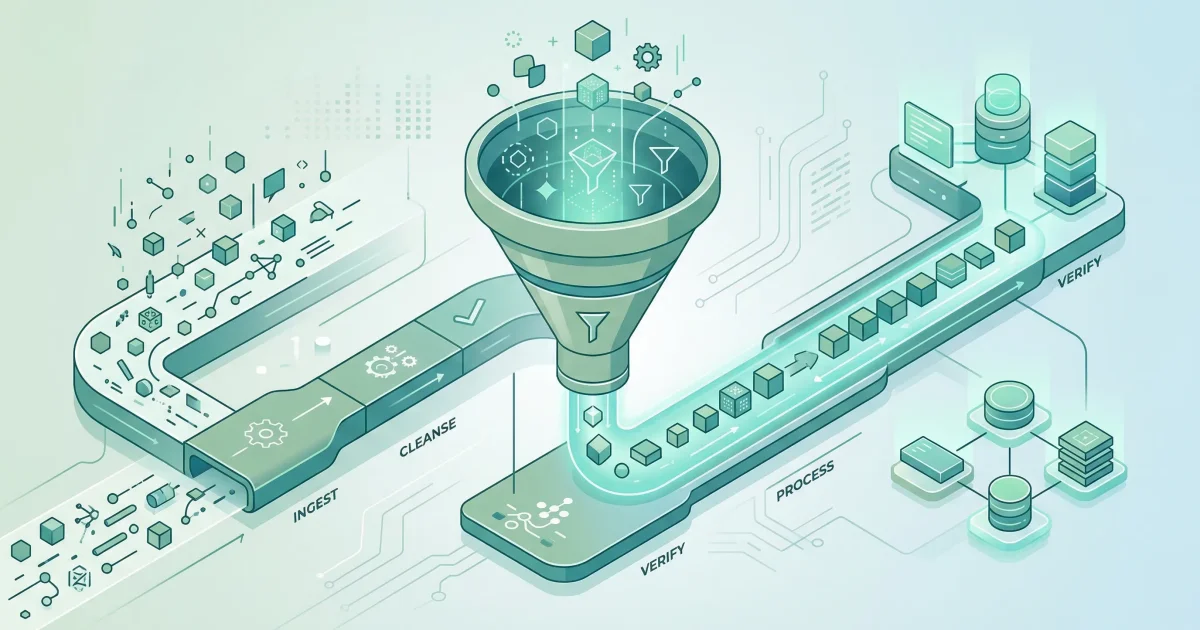

Data-Audit Uitvoeren: 5-Stappenplan

Voordat je AI implementeert, doe een grondige data-audit. Hier is hoe:

Stap 1: Inventariseer databronnen

Wat: Lijst alle systemen met relevante data

Checklist:'

ERP, CRM, webshop, DMS, e-mail

Excel-sheets, Access-databases, lokale drives

Legacy systemen, cloud apps

Wie is eigenaar? Wie heeft toegang?

Stap 2: Controleer volledigheid

Wat: Meet percentage missing/null values per veld

Tool: SQL-query of Excel Power Query

Voorbeeld:'

Klant-tabel: 1.200 records

- E-mail: 180 null → 15% missing

- Telefoon: 450 null → 38% missing

- Sector: 900 null → 75% missing ⚠️

Norm: Voor kritieke velden: < 5% missing. Voor ML-features: < 15%.

Stap 3: Test nauwkeurigheid

Wat: Sample 100 random records en valideer handmatig

Checks:'

Kloppen adressen? (test via Google Maps)

Zijn e-mails geldig? (syntax check + bounce check)

Kloppen bedragen met facturen?

Zijn productcodes juist gekoppeld?

Norm: > 95% accuraat voor kritieke data.

Stap 4: Check consistentie

Wat: Zoek duplicaten en variaties

SQL-queries:'

Vind klanten met zelfde e-mail maar andere naam

Vind producten met vergelijkbare naam (fuzzy matching)

Check of datum-formaten consistent zijn

Norm: < 2% duplicaten, alle dateformats hetzelfde.

Stap 5: Analyseer actualiteit

Wat: Wanneer is data laatst geüpdatet?

Checks:'

Check "last_modified" timestamps

Zijn er records > 2 jaar oud zonder updates? (vermoedelijk verouderd)

Hoe vaak updaten kritieke velden? (realtime, dagelijks, wekelijks?)

Norm: Afhankelijk van proces. Voorraad = realtime, klantdata = maandelijks OK.

Data Governance Opzetten: Borgen van Kwaliteit

Een eenmalige opschoonronde is niet genoeg. Je hebt structurele governance nodig.

1. Wijs Data Owners aan

Wie: Eén persoon verantwoordelijk per dataset (klanten, producten, financieel)

Rol: Bewaakt kwaliteit, lost issues op, keurt wijzigingen goed

Tip: Maak dit onderdeel van functieomschrijving + KPIs

2. Definieer Data Standards

Documenteer HOE data moet:

Bedrijfsnaam: Voluit, zonder afkortingen, inclusief rechtsvorm

Datum: YYYY-MM-DD (ISO 8601)

Bedrag: Altijd 2 decimalen, punt als separator (1234.56)

Status: Gebruik vaste waardelijst (geen vrije invoer)

3. Automatiseer Validatie

Bouw checks in je systemen:

Verplichte velden - kan niet opslaan zonder

Format validatie - e-mail moet @ hebben, postcode moet patroon volgen

Range checks - bedrag kan niet negatief, datum niet in toekomst

Duplicate detection - waarschuwing als klant al bestaat

4. Monitor Realtime

Dashboard met datakwaliteit-KPIs:

Metric | Target | Huidig |

|---|---|---|

% Complete records | > 95% | 87% ⚠️ |

% Accurate records | > 98% | 96% 🟡 |

Duplicaten | < 1% | 0.3% ✅ |

Data freshness (gem. days) | < 7 | 4 ✅ |

Alerting wanneer metrics onder target komen.

5. AVG-Compliance Borgen

AI en data governance = automatisch AVG-discussie:

Minimalisatie - verzamel alleen data die je nodig hebt

Bewaartermijn - verwijder oude data automatisch

Toegangsrechten - niet iedereen hoeft alles te zien

Traceability - log wie wat wanneer heeft gewijzigd

Right to be forgotten - proces om klantdata compleet te verwijderen

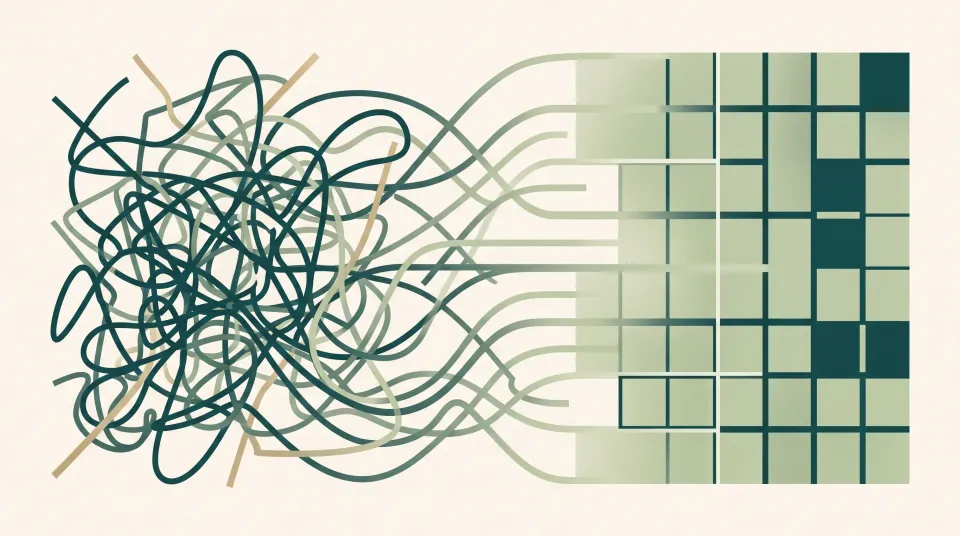

Praktisch Stappenplan: Van Chaos naar Kwaliteit

Hoe pak je dit aan in je organisatie?

Week 1-2: Quick Scan

Inventariseer databronnen

Voer data-audit uit (stappen 1-5)

Prioriteer: welke data is kritiek voor AI?

Week 3-6: Opschonen

Merge duplicaten (tools: Dedupe.io, Fuzzy Lookup)

Standaardiseer formats (datum, naam, adres)

Vul missende kritieke velden aan

Verwijder obsolete records

Week 7-10: Governance Implementeren

Wijs data owners aan

Documenteer data standards

Bouw validatieregels in systemen

Setup kwaliteits-dashboard

Week 11+: Continue Verbetering

Wekelijkse review kwaliteits-KPIs

Maandelijkse data owner meetings

Kwartaal: audit & opschoonronde

Train nieuwe medewerkers in data standards

Conclusie: AI is zo goed als je data

De meeste AI-projecten falen niet door slechte algoritmes, maar door slechte data. Investeer eerst in datakwaliteit voordat je AI implementeert - anders bouw je een Ferrari op een zandweg.

Goede data kenmerkt zich door:

✅ Volledigheid (< 5% missing)

✅ Actualiteit (realtime of dagelijks)

✅ Consistentie (standaard formats)

✅ Nauwkeurigheid (> 95% klopt)

✅ Relevantie (past bij doelstelling)

✅ Toegankelijkheid (geïntegreerd, API beschikbaar)

Budget 20-30% van je AI-investering voor data-opschoning en governance. Het loont zich altijd terug.

🚀 Volgende stappen:

Lees onze complete gids over AI Procesoptimalisatie voor het volledige traject

Twijfel over je datakwaliteit? Plan een gratis data-audit - we analyseren samen of je data AI-ready is.